Ethik

Ethical, Legal and Social Implications (ELSI)

Bei der Entwicklung und dem Einsatz von KI-Anwendungen spielen neben rechtlichen auch ethische und soziale Fragen eine wichtige Rolle: Wie gut können wir Bias oder Diskriminierung in unseren KI-Anwendungen vermeiden? Welche sozialen oder gesellschaftlichen Auswirkungen hat der Einsatz von KI? Unter welchen rechtlichen Bedingungen können wir KI in der Lehre einsetzen? Zur Beantwortung dieser Fragen, werden im IMPACT Projekt verschiedene Maßnahmen ergriffen. Wichtige Stakeholder, wie z.B. Studierende, Lehrende und Datenschutzbeauftragte, werden bereits zu Beginn des Projekts mit in den Entwicklungsprozess integriert. Durch regelmäßiges Informieren der Beilegten soll Transparenz geschaffen werden. Die DSGVO dient als Grundlage für das Datenschutzkonzept und die Anforderungen, welche sich daraus ergeben, werden sensibel umgesetzt. Auch auf Barrierefreiheit wird in den Anwendungen beachtet werden, sodass Zugänglichkeit für alle Betroffenen sichergestellt wird. Ein weiteres Augenmerk liegt auf dem Thema algorithmischer Bias, um ungewollte Diskriminierung in den KI-Anwendungen zu vermeiden.

Was ist Bias?

Bias kann während des maschinellen Lernprozesses entstehen. Bei der Datensammlung sowie der Entwicklung der Modelle können unbeabsichtigte und unerwünschte Ergebnisse dazu führen, dass verschiedene gesellschaftliche Gruppen diskriminierend werden könnten. So können z.B. bei Auswertungen von Texten Nachteile in Bezug auf die Geschlechtsidentität, Herkunftssprache oder Alter der Autor:innen entstehen. Dies gilt es selbstverständlich zu vermeiden.

Wie kann Bias vermieden werden?

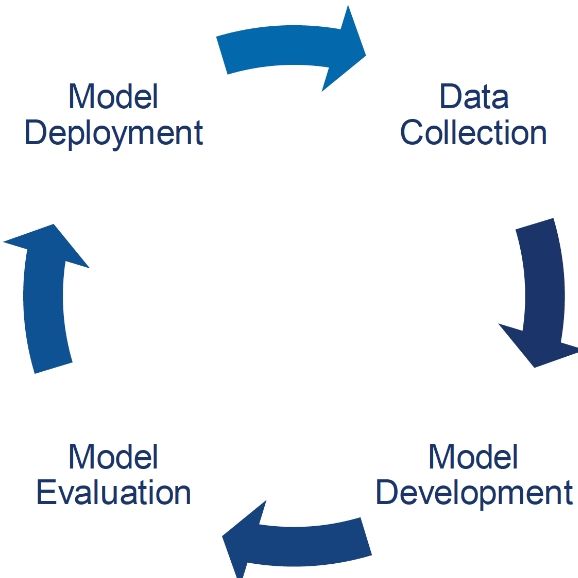

Bias kann entlang aller Entwicklungsschritte im Machine Learning Lifecycle auftreten: während der Sammlung von Daten, der Entwicklung und Evaluation der Modelle sowie dem späteren Einsatz dieser.

Im Rahmen des IMPACT Projektes werden für jeden Entwicklungsschritt Checklisten zur Prüfung auf Bias erstellt. So können frühzeitig mögliche Quellen für Bias identifiziert und negative Auswirkungen vermieden werden. Dazu kommen, entsprechend der Entwicklungsschritte, verschiedene Tools und statistische Verfahren zur Anwendung.

Checkliste zur Vermeidung von Bias

- Definition der Aufgabe und der Anwendungsfälle des Modells

- Identifikation und Dokumentation von unbeabsichtigtem Bias und Schäden

- Beteiligung unterschiedlicher Interessengruppen und verschiedener Perspektiven

- Identifikation von historische/gesellschaftlichen Verzerrungen, die in der Datenquelle vorhanden sein könnten

- Prüfung, ob die Datenquelle dem Einsatzkontext entspricht

- Überprüfung auf Verzerrungen im Vorgehen der Datensammlung

- Sicherstellen, dass der Erhebungsprozess selbst ethisch vertretbar ist

Checkliste zur Vermeidung von Bias

- Definition aller Annahmen, die das Modell treffen könnte

- Identifizierung des in den Annahmen enthaltenen Bias

- Prüfen, ob die Modellstruktur zu Fehlern führt

- Wahl einer geeignete Verlustfunktion

Checkliste zur Vermeidung von Bias

- Prüfen, ob die Testdaten mit dem Einsatzkontext übereinstimmen

- Sicherstellen, dass die Testdaten ausreichend repräsentativ sind

- Prüfen, ob die Evaluationsstudien die Ergebnisse für alle Zielgruppen berücksichtigen

- Miteinbeziehen der relevanten Stakeholder

- Verwendung geeigneter Metriken zur Überprüfung, ob die Anforderungen erfüllt werden

Checkliste zur Vermeidung von Bias

- Sicherstellung der Übereinstimmung zwischen Trainingsdaten, Testdaten und Proben in der Einsatzphase

- Prüfen, ob die Benutzerinteraktion zu Bias führt

- Fairness-Metriken überwachen

- Überwachung von Nutzerberichten und Nutzerbeschwerden

- Verschiedene Interessengruppen das System auf Bias prüfen lassen

Kontakt

Weiterführende Informationen zu Ethik und Datenschutz:

Link zum Trusted Analystics Verhaltenskodex für die Hochschulehre: https://www.researchgate.net/publication/340183667_Verhaltenskodex_fur_Trusted_Learning_Analytics

Leitlinien der Initiative D21 zum ethischen Umgang mit Algorithmen-Monitoring: https://initiatived21.de/app/uploads/2019/11/algomon_leitlinien_191119-1.pdf